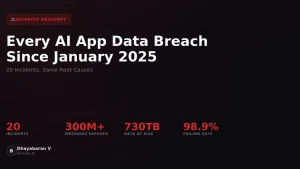

2025年1月以降の全AIアプリデータ侵害:20件のインシデント、同じ根本原因

概要

概要

2025年1月から2026年2月の間に、AIを搭載したアプリケーションで少なくとも20件のセキュリティインシデントが発生し、数千万人のユーザーの個人データが流出しました。これは、AIラッパー製品を急いで展開した結果、AIアプリのエコシステムに構造的なセキュリティ危機があることを示しています。CovertLabs、Cybernews、Escapeによる独立した調査は、これらの侵害がFirebaseデータベースの誤設定、Supabaseの行レベルセキュリティ(RLS)の欠如、ハードコードされたAPIキー、および露出したクラウドバックエンドという、同じ根本原因に起因していることを確認しました。具体例として、Chat & Ask AIの3億件以上のチャット履歴の漏洩、McDonald's McHireの6400万人の応募者データの漏洩、およびBondu AIトイの子供との会話の漏洩などが挙げられています。これらの脆弱性は、洗練された攻撃ではなく、設定ミスであり、責任ある開示後すぐに修正されました。記事は、このクラスの脆弱性を排除するための根本的なアーキテクチャ上の解決策は、ユーザーが制御するインフラストラクチャ上でオープンソースモデルを自己ホストすることであると結論付けています。

(出典:Blog Barrack Ai)